אפל הצטרפה זה עתה לרשימה הולכת וגדלה של ענקיות טכנולוגיה במפגן מחויבות לקידום פיתוח בטוח ואחראי של AI. זה מגיע מהשחרור של גרסת הבטא הראשונה של iOS הכוללת Apple Intelligence.

יצרנית האייפון חתומה על הנחיות בטיחות AI מרצון של ממשל ביידן, שהוצגו לראשונה ביולי 2023.

בהצטרפות להסכם, אפל מיישרת קו עם 15 שחקנים גדולים אחרים בתעשיית ה-AI, כולל OpenAI, Amazon, Google, Meta, Microsoft ו-Nvidia.

ההנחיות דורשות בדיקה קפדנית של מערכות בינה מלאכותית כדי לזהות סיכונים כגון הטיות מפלות, פרצות אבטחה ודאגות לביטחון לאומי.

מהן הנחיות בטיחות AI מרצון?

ההנחיות הוולונטריות מייצגות מאמץ של ממשל ביידן לקדם פיתוח בינה מלאכותית אחראית בהיעדר רגולציה רשמית.

הבית הלבן הגדיר את ההנחיות הוולונטריות כ"פעולות הגורפות ביותר שננקטו אי פעם" כדי להגן על אמריקאים מפני הסיכונים הפוטנציאליים של מערכות בינה מלאכותית.

להלן פירוט של רשימת ההמלצות המוצעת שלה:

הירשם כדי לקבל את המדריך הטוב ביותר של טום ישירות לתיבת הדואר הנכנס שלך.

קבל גישה מיידית לחדשות מרעננות, לביקורות החמות ביותר, למבצעים מעולים וטיפים מועילים.

- הקמת פרוטוקולים ברורים לאיסוף נתונים, שימוש ושיתוף כדי להבטיח ציות לחוקי הפרטיות.

- שיתוף מקורות נתונים המשמשים להכשרת מודלים של AI כדי לאפשר ביקורת חיצונית.

- יצירת מנגנונים למעקב והסבר על תהליכי קבלת החלטות בינה מלאכותית, הפיכת מערכות לביקורת.

- מתן הסברים ברורים של הגורמים, הנתונים והשיקולים האתיים המשפיעים על החלטות בינה מלאכותית.

- פרסום דוחות שקיפות המפרטים כיצד מערכות בינה מלאכותית מגיעות למסקנות, כולל דוגמאות לתפוקות מוטות.

- דרישה מספקי AI לכלול מדדי KPI של הגינות ושקיפות, עם דיווח קבוע.

- הגדרת ביקורות תקופתיות לזיהוי הטיות, עם נהלים ברורים לטיפול בבעיות שנמצאו.

- מאפשר לחברות הרוכשות פתרונות בינה מלאכותית לקבל זכויות בדיקה וביקורת לביצוע הערכות עצמאיות.

- טיפוח גיוון בצוותים המתכננים מערכות בינה מלאכותית כדי לשלב נקודות מבט רחבות יותר ולזהות הטיות פוטנציאליות.

- טיפול יזום בהטיות על ידי קידום השימוש במערכי נתונים מגוונים בהכשרת AI

- מתן ממשקים אינטראקטיביים המאפשרים למשתמשים לחקור ולתת משוב על גורמים המשפיעים על החלטות AI.

- קביעת תהליכים ברורים למשתמשים לערעור או לבקש הסברים להחלטות מונעות בינה מלאכותית המשפיעות עליהם.

למרות שאינה מחייבת מבחינה משפטית, ההסכם מעודד שקיפות ושיתוף פעולה בין מנהיגי התעשייה, סוכנויות ממשלתיות, ארגוני חברה אזרחית ואקדמיה.

כשהקונגרס ממשיך להתמודד עם האתגרים של ויסות בינה מלאכותית, יוזמות כמו הסכם הבטיחות הוולונטרי משמשות קפיצת מדרגה לקראת מסגרת ממשל מקיפה יותר.

מה גרם לאפל לחתום על ההנחיות?

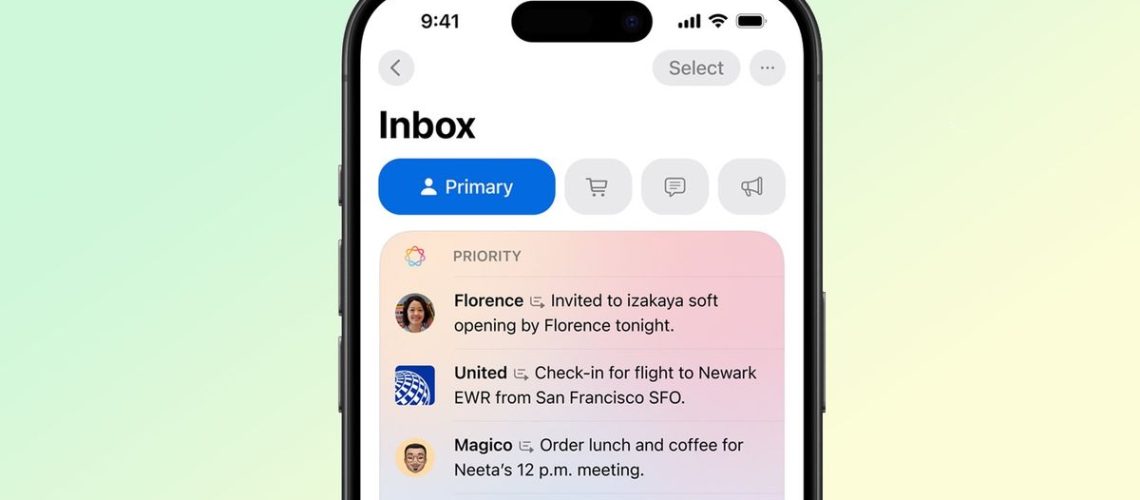

המחויבות החדשה הזו מגיעה ברגע מרכזי עבור אפל, כשהיא מתכוננת לשלב את הצ'אטבוט ChatGPT של OpenAI בעוזרת הקולית שלה באייפון Siri.

יהיו כוונותיהן אשר יהיו, חברות יכולות לחזור בקלות על הבטחות שניתנו באמצעות התחייבויות וולונטריות מבלי לעמוד בפני קנסות או קנסות רשמיים.

השותפות גררה בדיקה של כמה ממנהיגי התעשייה, כולל מנכ"ל טסלה אילון מאסק, שהביע דאגות לגבי השלכות האבטחה של שילוב הטכנולוגיה של OpenAI ברמת מערכת ההפעלה ב-iOS.

אמנם מדובר בהפגנת מחויבות טובה מצד אפל בתקופה שבה עמדתה לגבי פרטיות הועמדה בספק, אבל חשוב לציין שהמהלך הזה יותר סמלי מכל דבר אחר.

ההנחיות החדשות לבטיחות בינה מלאכותית לא הוכנסו לחוק, מה שאומר שאין השלכות משפטיות להפרתן גם לאחר התחייבות חתומה.

ככל שתעשיית הבינה המלאכותית ממשיכה להתרחב, הצורך בתקנות אכיפה יותר לא יכול להיות דחוף יותר.

יהיו כוונותיהן אשר יהיו, חברות יכולות לחזור בקלות על הבטחות שניתנו באמצעות התחייבויות וולונטריות מבלי לעמוד בפני קנסות או קנסות רשמיים.