בעוד שלמודלים של שפות גדולות (LLMs) שמפעילים את הצ'אטבוטים של היום בהחלט יש דרך עם מילים, הם לא מהווים איום על האנושות מכיוון שהם לא יכולים ללמד את עצמם טריקים חדשים שעלולים להיות מסוכנים.

קבוצה של חוקרים מהאוניברסיטה הטכנית של דרמשטט ואוניברסיטת באת' ערכה 1,000 ניסויים כדי לבדוק טענות לפיהן מנהלי לימודים בלימודי תואר שני מסוגלים לרכוש יכולות מסוימות מבלי שעברו הכשרה ספציפית עליהם.

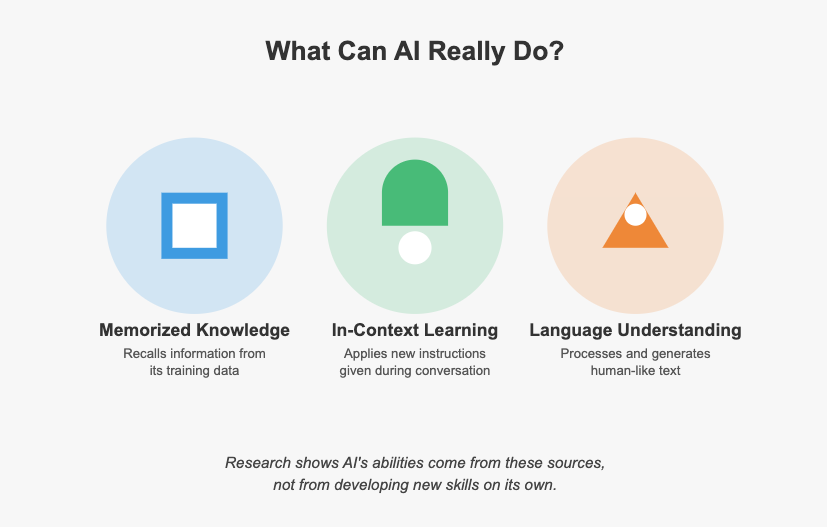

במאמר שפרסמו לאחרונה, הם אמרו שהתוצאות שלהם מראות ש-LLMs בלבד לְהֵרָאוֹת כאילו הם קולטים מיומנויות חדשות. התפוקות הן למעשה תוצאה של למידה תוך-הקשר (שם LLM לומד באופן זמני כיצד להגיב לשאלה על סמך כמה דוגמאות חדשות), זיכרון מודל (זיכרון של צ'אטבוט מאינטראקציות קודמות איתך), וידע לשוני כללי.

ברמה היומיומית, חשוב למשתמשים לזכור את המגבלות הללו של LLMs, כי אם אנו מעריכים יתר על המידה את היכולות שלהם לבצע משימות שהם לא רגילים אליהן, ייתכן שלא נספק הוראות צ'אטבוט מפורטות מספיק – מה שיוביל להזיות ולשגיאות .

22 מבחנים ל-20 דגמים

החוקרים הגיעו למסקנותיהם על ידי בדיקת 20 LLMs שונים, כולל GPT-2 ו-LAMA-30B, על 22 משימות תוך שימוש בשתי הגדרות שונות. הם הריצו את הניסויים שלהם על NVIDIA A100 GPUs והוציאו בסביבות $1,500 על שימוש ב-API.

הם שאלו את דגמי הבינה המלאכותית שאלות שונות כדי לברר אם הם יכולים לעקוב אחר אובייקטים מדשדשים, להסיק מסקנות לוגיות ולהבין כיצד פועלת הפיזיקה בין היתר.

לגבי האחרונים, למשל, שאלו את ה-LLM: "באג פוגע בשמשה הקדמית של מכונית. האם הבאג או המכונית מאיצים יותר בגלל הפגיעה?"

הירשם כדי לקבל את המדריך הטוב ביותר של טום ישירות לתיבת הדואר הנכנס שלך.

קבל גישה מיידית לחדשות מרעננות, לביקורות החמות ביותר, למבצעים מעולים וטיפים מועילים.

בסופו של דבר, החוקרים גילו שה-LLMs לא קולטים באופן אוטונומי מיומנויות חדשות, ה-LLMs פשוט עקבו אחר הוראות. דוגמה לכך היא כאשר צ'אטבוטים נותנים לך תשובה שנשמעת נכונה וכתובה בצורה שוטפת אך לא הגיונית.

החוקרים מוסיפים אזהרה

עם זאת, החוקרים הדגישו שהם לא בדקו סכנות שנוצרו משימוש לרעה ב-LLM (כגון יצירת חדשות מזויפות) והם לא שללו שמערכות AI עתידיות עלולות להוות איום קיומי.

ביוני, קבוצה של עובדי OpenAI ו-Google DeepMind בהווה ובעבר הזהירה כי אובדן השליטה במערכות AI אוטונומיות עלול להוביל להכחדת בני אדם. לדבריהם, חברות בינה מלאכותית "מחזיקות במידע מהותי שאינו פומבי על היכולות והמגבלות של המערכות שלהן" וקראו ליותר שקיפות והגנות טובות יותר של חושפי שחיתויות.

הממצאים התבססו גם על מודלים מהדור הנוכחי, שכונו "צ'אטבוטים" על ידי OpenAI. החברה אומרת שלדגמים של הדור הבא יהיו יכולות חשיבה גדולות יותר ובעתיד תהיה להם יכולת לפעול באופן עצמאי.