OpenAI הזינה בטפטוף מידע על העתיד של דגמי הבינה המלאכותית שלה והאם זה ייקרא GPT-5, GPT-5o, או משהו אחר לגמרי.

ההערות האחרונות של ה-CTO מירה מוראטי מציעות בתוך שנתיים שיהיה לנו משהו אינטליגנטי כמו פרופסור. זה כנראה יתבסס על טכנולוגיית GPT-4o שהוכרזה מוקדם יותר השנה עם יכולות קול וראייה מקוריות.

"אם אתה מסתכל על מסלול השיפור, GPT-3 היה אולי אינטליגנציה ברמת פעוטות, מערכות כמו GPT-4 הן אינטליגנציה חכמה של תיכוניסטים ובשנתיים הקרובות אנו בוחנים אינטליגנציה ברמת PhD עבור משימות ספציפיות", היא אמר במהלך שיחה בדארטמות'.

יהיו לך מערכות בינה מלאכותית ש… מתחברים לאינטרנט, סוכנים מתחברים אחד לשני ועושים משימות ביחד, או סוכנים שמתחברים לבני אדם ומשתפים פעולה.

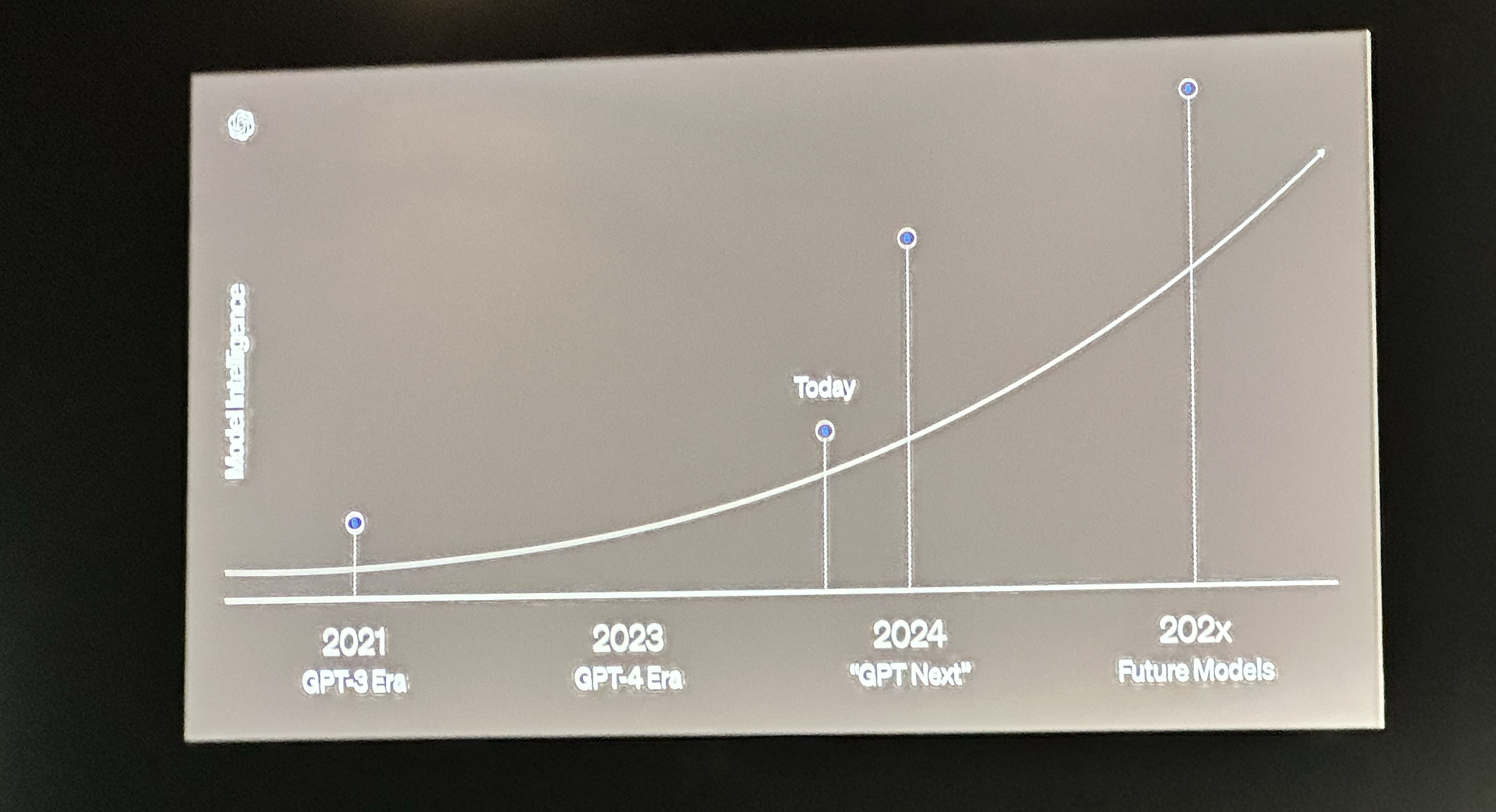

חלקם שלקחו את זה כדי להציע שנחכה שנתיים ל-GPT-5 אבל מסתכלים על גילויים אחרים של OpenAI, כמו גרף המציג את 'GPT-Next' השנה ו'מודלים עתידיים' בהמשך והמנכ"ל סם אלטמן מסרב להזכיר את GPT -5 בראיונות האחרונים – אני לא משוכנע.

השחרור של GPT-4o היה מחליף משחק עבור OpenAI, ויצר משהו חדש לגמרי מאפס שנבנה כדי להבין לא רק טקסט ותמונות אלא קול וחזון מקומיים. למרות שזה עדיין לא שיחרר את היכולות האלה, אני חושב שהכוח של GPT-4o הוביל לשינויים גדולים.

עם זאת, החברה נתונה גם ללחץ הולך וגובר מתחרות ומציאות מסחרית. בבדיקות האחרונות, נראה כי קלוד של Anthropic מנצח את ChatGPT ומטה מגדילה את ההשקעה בבניית בינה מלאכותית מתקדמת.

ChatGPT: למה אנחנו יכולים לצפות מהדור הבא?

דגם הדור האחרון, GPT-4, יצא במרץ אשתקד, ואחריו כמה עדכונים קלים. ואז GPT-4o הושק מוקדם יותר השנה, סוג חדש של דגם מולטי-מודאלי אמיתי.

הירשם כדי לקבל את המדריך הטוב ביותר של טום ישירות לתיבת הדואר הנכנס שלך.

שדרג את חייך עם מנה יומית של החדשות הטכנולוגיות הגדולות ביותר, פריצות לסגנון חיים וניתוח שנקבע שלנו. היה הראשון לדעת על גאדג'טים חדישים ועל המבצעים החמים ביותר.

מאז ההצלחה של ChatGPT OpenAI הפכו גם לזהירים יותר וגם ממוקדים יותר במוצר, ולאחרונה החלה אלטמן לדבר על הפיכתה לחברה למטרות רווח מתוך כוונה לפעול לקראת רישום ציבורי.

ככל הנראה ההתמקדות עדיין בבניית אינטליגנציה כללית מלאכותית, אבל ההערות של מוראטי שבאזורים מסוימים היא כבר אינטליגנטית כמו בני אדם, מרמזות כנראה על שינוי בהגדרה לכיוון של משימות ספציפיות ולא מערכות כלליות.

איך OpenAI יגיע לדור הבא?

מוראטי אומר שיש נוסחה פשוטה ליצירת מודלים מתקדמים של AI. אתה צריך לקחת מחשוב, נתונים ולמידה עמוקה ולחבר אותם יחד. קנה מידה של נתונים ומחשוב מוביל למערכות AI טובות יותר. גילוי זה יוביל לזינוקים משמעותיים קדימה.

"אנחנו בונים על עשרות על עשרות שנים של מאמץ אנושי. מה שקרה בעשור האחרון הוא שילוב של רשתות עצביות, המון נתונים והמון מחשוב. אתה משלב את שלושת הדברים האלה ומקבל מערכות טרנספורמטיביות שיכולות לעשות דברים מדהימים", אמר מוראטי.

מוראטי אמר שלא ברור כרגע כיצד המערכות הללו פועלות בפועל, אלא רק שהן עובדות עקב ביצוע זה במשך שלוש שנים וצפייה בשיפורים לאורך זמן.

"זה מבין שפה ברמה דומה שאנחנו יכולים", אמרה. "זה לא שינון מה הלאה, זה מייצר את ההבנה שלו לגבי דפוס הנתונים שהוא ראה בעבר. מצאנו גם שזו לא רק שפה. לא אכפת לו איזה נתונים אתה מכניס לשם."

במהלך השנים הקרובות מוראטי אומר שנקבל אינטליגנציה ברמת דוקטורט עבור משימות ספציפיות. נוכל אפילו לראות חלק מזה בשנה הקרובה עד 18 חודשים. המשמעות היא שתוך שנתיים תוכל לנהל שיחה עם ChatGPT על נושא שאתה מכיר היטב וזה ייראה חכם יותר ממך או מהפרופסור שלך.

מה קורה כאשר ChatGPT עולה על כל האינטליגנציה האנושית?

מוראטי אומר שעבודת בטיחות סביב דגמי AI עתידיים היא חיונית. "אנחנו חושבים הרבה על זה. זה בהחלט אמיתי שיהיו לך מערכות בינה מלאכותית שיש להן יכולות סוכן, מתחברים לאינטרנט, סוכנים שמתחברים זה לזה ועושים משימות ביחד, או סוכנים שמתחברים לבני אדם ומשתפים פעולה בצורה חלקה", אמרה.

זה יכלול מצבים שבהם בני אדם "יעבדו עם AI כמו שאנחנו עובדים זה עם זה היום", באמצעות מערכות דמויות סוכנים.

לדבריה, בניית מעקות בטיחות צריכה להיעשות לצד הטכנולוגיה בצורה משובצת כדי לעשות את זה נכון. "הרבה יותר קל לכוון מערכת חכמה יותר בכך שהיא אומרת לה לא לעשות את הדברים האלה מאשר לכוון מערכת פחות חכמה."

"מודיעין ובטיחות הולכים יד ביד", הוסיף מוראטי. היא אמרה שצריך לחשוב על בטיחות ופריסה, אבל במונחים של מחקר גם בטיחות וגם שיפורים הולכים יד ביד.

מה שלא ברור הוא כיצד יופיעו תכונות חדשות ויכולות מתקדמות. זה הצריך מדע חדש של חיזוי יכולות כדי לראות כמה מסוכן עשוי להיות מודל חדש ומה ניתן לעשות כדי להפחית את הסיכונים הללו בעתיד.